Astroturfing é uma estratégia de Relações Públicas que visa orquestrar o debate por meio de um público simulado. Para Silva (2015), o Astroturfing é a tentativa de orquestrar uma sensação de apoio público a uma causa, ideia ou organização, isto é, uma manifestação expressiva de um público deveras, simulado.

Silva (2015) propõe uma diferença entre público simulado e público autêntico, sendo o primeiro forjado inicialmente com práticas de Astroturfing e, em seguida, congregado por pessoas que se ligam aos discursos fabricados compondo o que o autor chama de público autêntico.

O Astroturfing tem sido abordado por trabalhos de Relações Públicas que denunciam tal prática (Stauber e Rampton, 1995; Hoggan, 2006; Hoggan e Littlemore, 2009). E, também por uma tomada ampliada de críticas sobre práticas pouco éticas de comunicação arquitetadas por agências de relações públicas financiadas por organizações privadas (Silva, 2011; Henriques e Silva, 2013).

Assim como, também tem sido relacionado aos temas Política, Mídias e Astroturfing, como o trabalho de Junior Lima et al (2014), que analisa como o Astroturfing foi utilizado na agenda dos presidenciáveis da eleição de 2014, relacionando o conteúdo televisivo com palavras-chave nos canais oficiais do Twitter.

Mas, depois do advento da internet e das redes sociais, o Astroturfing também ganhou espaço no digital, ganhando assim a prerrogativa de Astroturfing Digital. Neste post o doutorando em Ciência Política Rangel Ramos, apresenta uma revisão sistemática da literatura de Astroturfing Digital, que foi composta para incrementar sua tese.

Da Roma antiga às hashtags do Twitter

Segundo Silva (2015), a prática de Astroturfing sempre esteve presente na dinâmica da Política, inclusive, o autor cita o episódio em que Júlio César é esfaqueado pelo Senado Romano quando volta de suas conquistas bélicas. O autor narra que os senadores receberam cartas anônimas que denunciavam práticas escandalosas de César, que custavam muito caro aos cofres públicos. Nisso, ficaram convencidos de que o melhor seria eliminar o imperador.

No entanto, segundo Silva (2015), “foi apenas no início da década de 1990 que o termo astroturfing, indicando uma ação, passou a ser utilizado para se referir a tal prática. Um dos primeiros casos no qual o termo aparece é em um artigo do jornal canadense Lethbridge Herald, de 1993, no qual há a afirmação que “esse tipo de campanha grassroots – utilizando cartas e cartões impressos com antecedência – é conhecido como astroturfing” (SWEET, 1993, p. 1, no original em inglês). É como astroturfing que o termo passou a ser reconhecido nos principais dicionários americanos e ganhou notoriedade pública” (Silva, 2015:16).

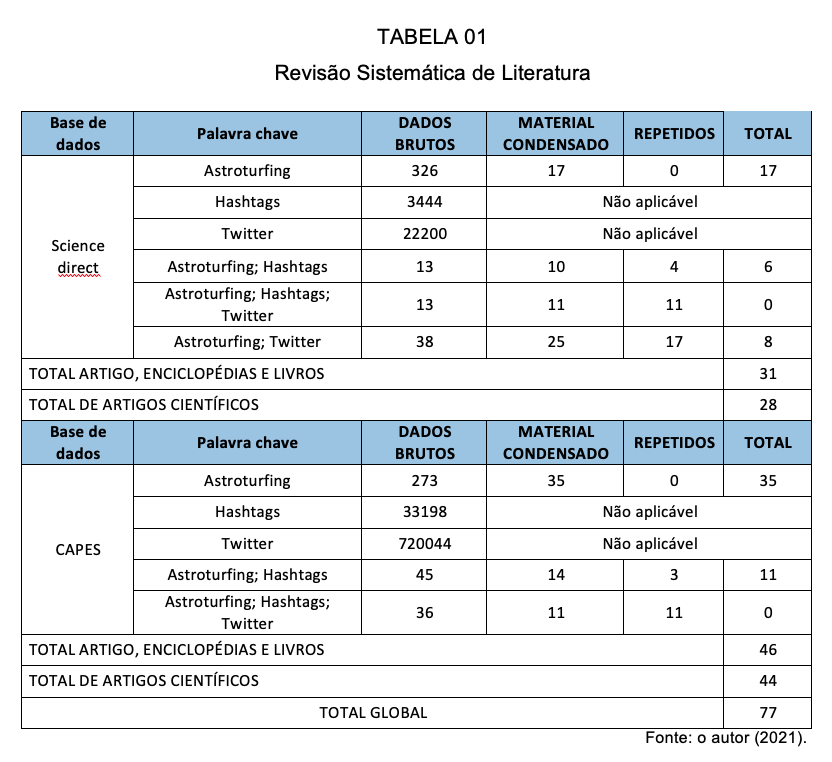

Mas, a partir de uma abordagem sistemática foi possível identificar e selecionar os principais trabalhos na área e obter um panorama global do tema em estudo. A revisão foi estabelecida em três etapas: (1) Planejamento da revisão; (2) Condução da revisão e (3) Entendimento do panorama. Na primeira etapa, a proposta foi alinhar o tema da pesquisa e elaborar o protocolo de coleta, ajustando a busca central para identificar quais são os trabalhos que tratam de Astroturfing no Twitter. Baseado nessa temática, o protocolo de coleta foi elaborado a partir de duas bases de dados: a Science Direct e o Portal Capes.

Em cada base de dados, os termos mais utilizados foram testados no mecanismo de busca, até que se identificou as palavras que deixariam a pesquisa mais precisa. Nisso, três termos foram definidos para serem analisados: “Astroturfing”, “Twitter” e “Hashtags”. Porém, “Twitter” e “Hashtags” foram termos que atraíram um número muito alto de material, inviabilizando o tratamento da amostragem, por isso, decidiu-se por utilizar os termos combinados: “Astroturfing; Hashtags”, “Astroturfing; Twitter” e “Astroturfing; Hashtags; Twitter”. E, para além dos termos, foram aplicados filtros como: artigos revisados por pares; texto em inglês e/ou português; raspagem em enciclopédias e livros.

Na segunda etapa da revisão, os artigos foram selecionados em função da pertinência e relação com o tema, ou seja, se o artigo tinha como essência a análise do Astroturfing no Twitter. Após essa seleção, foi realizada uma leitura dinâmica dos artigos, focada no título, resumo e palavras-chave. Considerando, inclusive, a relação do tema do artigo com a discussão científica sobre Política e/ou Comunicação Política. A Tabela 1 mostra a condução da pesquisa, que aconteceu entre os dias 30 de abril a 4 de maio de 2021.

Na terceira etapa da revisão sistemática buscou compreender o panorama geral da literatura sobre o tema. A partir da leitura prévia dos artigos, percebeu-se uma mudança nas abordagens científicas.

De 2010 até 2014, os trabalhos tratavam basicamente da ação dos bots e algoritmos nas plataformas sem muito aprofundamento nas questões discursivas. Em muitos trabalhos havia um interesse em mostrar que as práticas de Astroturfing eram determinadas pela plataformização midiática.

Mas, de meados de 2014 até 2018, os trabalhos passaram a olhar mais para o fenômeno das Fake News e da desinformação. Neste momento, questões a respeito das novas dinâmicas dos Movimentos Sociais passaram a ser mais relevantes para os pesquisadores. Motivados, principalmente, pelo fenômeno da Primavera Árabe, as pesquisas começaram a identificar e defender a ideia de que a coletividade é um agente fundamental para propagação de informações (Criado et al, 2O16; Feltwell et al, 2017; Ferrara, 2O17), para além da constituição dos algoritmos das plataformas.

De 2019 em diante, as pesquisas, então, passaram a inferir sobre a prerrogativa de que o Astroturfing apresenta técnicas de persuasão através de rumores e narrativas, mas, sem abandonar os avanços anteriores, como é o caso da pesquisa de Howard et al (2O18), que ilustra como os bots políticos têm sido usados para manipular a opinião pública.

Trabalhos sobre Astroturfing Digital

O trabalho de Wu et al (2O19) é um exemplo de pesquisa que defende que a maioria dos métodos busca identificar rumores, apenas, na informação linguística, sem considerar a dinâmica temporal e os padrões de propagação. No entanto, segundo os autores, os rumores nas redes sociais colocam em risco a segurança social. Por isso, pesquisas sobre a detecção de boatos têm despertado muito interesse não só na academia, mas na indústria também, principalmente, quando se trata de usar Astroturfing para a positivação de produtos e marcas em fóruns de avaliações.

Do ponto de vista metodológico, a pesquisa de Wu et al (2O19) é uma das primeiras a utilizar o que eles chamam de “aprendizagem de representação” (tradução livre para “framework of representation learning”) para identificar os rumores na rede. Em resumo, os pesquisadores apresentam uma nova forma de construir o gráfico de propagação seguindo a estrutura “quem responde quem” nas postagens do Twitter e, em um segundo momento, apresentam um algoritmo baseado na rede neural dos grafos, denominado PGNN, que pode gerar representações poderosas para cada nó do grafo de propagação.

De acordo com os pesquisadores, o algoritmo PGNN atualiza repetidamente as representações dos nós, trocando informações entre os nós vizinhos por meio de caminhos de relação em intervalos de tempo limitados” (Wu et al 2O19:01). Com base nisso, chegam em dois modelos: GLO-PGNN, modelo de detecção de rumor baseado na incorporação global com rede neural de propagação de grafos) e ENS-PGNN (modelo de detecção de rumores baseado na aprendizagem por conjunto com rede neural dos grafos de propagação).

Um dos trabalhos mais recentes que a revisão identificou resgata a ideia de identificação de bots. Ilias e Roussaki (2O21) apresentam dois métodos baseados em Processamento de Linguagem Natural (PNL) com o objetivo de distinguir usuários legítimos de bots. Os pesquisadores apresentaram uma nova abordagem de extração de dados para identificar contas que postam mensagens automatizadas. Depois disso, submetem os dados a algoritmos de aprendizado de máquina. No segundo momento, propõem uma arquitetura de aprendizado para identificar se os tweets foram postados por usuários reais ou gerados por bots.

Já o trabalho de Zhang et al (2O21) investiga a dinâmica das notícias “boca a boca” em meio digital, que os autores chamam de eWOM – word-of-mouth. Eles analisam o ceticismo da eWOM por meio de três dimensões: suspeita de motivação, suspeita de veracidade e suspeita de identidade, acrescentando uma análise sobre as variações e relações entre as três dimensões. Além disso, o estudo avalia como a confiança em um indivíduo e as percepções em relação à garantia estrutural em que ele está inserido podem impactar cada dimensão, o que por sua vez afeta a avaliação da credibilidade das mensagens eWOM.

A pesquisa de Henrie et al (2O19) examinou a eficácia do Astroturfing na mitigação das defesas naturais dos cidadãos contra mensagens politicamente persuasivas. Os autores sugerem que os cidadãos são mais propensos a ser persuadidos por uma mensagem de Astroturfing, independentemente de suas inclinações políticas. Nesse sentido, segundo os pesquisadores, em um contexto de longo prazo, o Astroturfing é entendido como uma adição perigosa à comunicação persuasiva.

Por fim, o trabalho de Haupt et al (2O21) analisa tópicos de conversas de usuários online e discursos no Twitter relacionados ao movimento de protesto “Liberate” em reação às diretrizes de distanciamento social nos estágios iniciais da pandemia COVID-19. Haupt et al (2O21) utilizaram abordagens em big data, aprendizado de máquina, análise de conteúdo e análise de rede social para caracterizar o comportamento, os temas de conversação e as estruturas de rede de apoiadores e não apoiadores do protesto do Liberate.

Os tuítes foram codificados e agrupados em tópicos produzidos a partir de um algoritmo de aprendizado de máquina não supervisionado usando processamento de linguagem natural (PNL). Uma análise dos grupos de tópicos descobriu que os tuítes que apoiam os protestos são altamente concentrados e têm volumes maiores de tuítes replicados. Os pesquisadores apontam que apoiadores do protesto também eram mais inclinados a retuitar outros usuários, enquanto os não-apoiadores eram mais propensos a incluir uma URL de uma fonte de mídia externa e produzir um tuíte exclusivo.

A análise de rede também foi usada para avaliar as características das redes de retuíte e descobrir se a rede apoiadora tinha uma estrutura mais centralizada e influenciada por uma organização política, em contraste com a rede não-apoiadora, que tinha um número maior de pequenas e uniformes redes com nós de grande porte e mais impulsionados por personalidades da mídia e comentaristas.

Segundo Haupt et al (2O21), essas características indicam que os apoiadores do protesto tinham um discurso mais centralizado, consistente e disseminado contra os requisitos de distanciamento social do COVID-19. Já os não-apoiadores, eram mais diversificados em suas críticas ao movimento “Liberate” e, geralmente, mais fragmentados em seu apoio às medidas de saúde pública.

Por: Rangel Ramos

REFERÊNCIAS BIBLIOGRÁFICAS

CRIADO, N., RASHID, A., LEITE, L. Flash mobs, Arab Spring and protest movements: Can we analyze group identities in online conversations? Expert Systems with Applications, Volume 62, 15 November, 2016.

FELTWELL, T; VINES, J; SALT, K. Counter-Discourse Activism on Social Media:

The Case of Challenging “Poverty Porn” Television. Computer Supported Cooperative Work (CSCW) May, 2017.

FERRARA, E. Contagion dynamics of extremist propaganda in social networks. Information Sciences Volumes 418–419, Pages 1-12. December, 2017.

GARRETT, R., CARNAHAN, D., & LYNCH, E. (2013). A turn toward avoidance? Selective exposure to online political information, 2004-2008. Political Behavior, 35, 113–134. doi:10.1007/ s11109-011-9185-6 , 2013.

HENRIQUES, M. S.; SILVA, D. R. Meras coincidências: as estratégias e as tramas do acontecimento fabricado. Revista Comunicação Midiática, v.7, n.3, p. 215-233, 2012.

HAUPT, M. JINICH-DIAMANT, A., LI, J., NALI, M., MACKEY, T.K. Characterizing twitter user topics and communication network dynamics of the “Liberate” movement during COVID-19 using unsupervised machine learning and social network analysis. Online Social Networks and Media, Volume 21, January 2021

HENRIE, K. M; GILDE C. “An Examination of the Impact of Astroturfing on Nationalism: A Persuasion Knowledge Perspective” Social Sciences 8, no. 2: 38. (2019) – https://doi.org/10.3390/socsci8020038

HOGGAN, James. Astroturf: The Only Grass That Withstands Toxic Friends of 197 Science. DesMogBlog, publicado em 06 set. 2006. Disponível em:

<https://www.desmogblog.com/astroturf-the-only-grass-that-withstands-toxic-friends-of-science>. Acesso em: 23 de set 2019.

HOGGAN, James; LITTLEMORE, Richard. Climate Cover-Up: The Crusade to Deny Global War- ming. Greystone Books, 2009.

ILIAS, L., ROUSSAKI, I. Detecting malicious activity in Twitter using deep learning techniques. Applied Soft Computing, Volume 107, August 2021

JUNIOR LIMA, Walter T. Projeto Neofluxo: atuação eleitoral do Astroturfing no fluxo informativo na WEB / Walter Teixeira Lima Junior, Amanda Luiza Silva Pereira, Rafael Vergili. São Paulo: [s.n.], 2014.

KOVIC, Marko. RAUCHFLEISCH, Adrian; SELE, Marc. Digital astroturfing in politics: Definition, typology, and countermeasures. Studies in Communication Sciences 18.1 (2018), pp. 69–85.

PENG, J; DETCHON, S; RAYMOND CHOO, K-K, ASHMAN, Helen. Astroturfing detection in social media: a binary n-gram–based approach. Concurrency and Computation: Pract Exper. 2017;29:e4013. September, 2016.

SILVA, D. R. (2015). Astroturfing: lógicas e dinâmicas de manifestações de públicos simulados. Belo Horizonte: FAFICH/Selo PPGCOM/UFMG.

STAUBER, John; RAMPTON, Sheldon. Toxic sludge is good for you: Lies, damn lies and the public relations industry. Monroe: Common Courage Press, 1995.

STAUBER, John; RAMPTON, Sheldon. Trust us, we’re experts! How industry manipulates science and gambles with your future. New York: Penguin Put- nam, 2002.

Wu, Z., Pi, D., Chen, J., Xie, M., Cao, J. Rumor detection based on propagation graph neural network with attention mechanism. Expert Systems with Applications, Volume 158, 15 November 2020.

ZHANG, X., WU, Y. and WANG, W., “eWOM, what are we suspecting? Motivation, truthfulness or identity”, Journal of Information, Communication and Ethics in Society, Vol. 19 No. 1, pp. 104-128 – 2021 – https://doi.org/10.1108/JICES-12-2019-0135